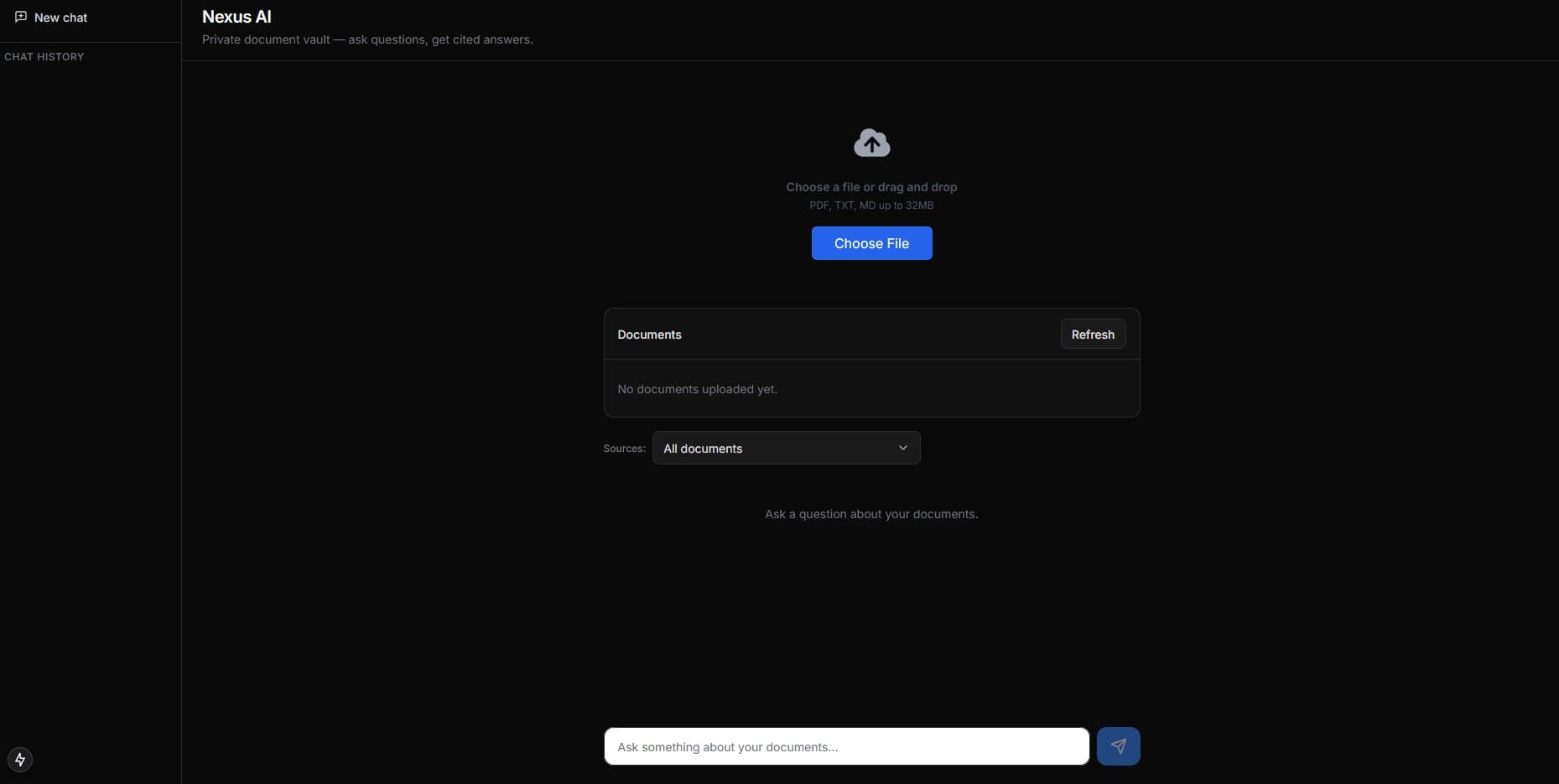

Nexus KI

Privates Dokumenten-Vault: Dateien hochladen, sofort zitierfähige Antworten. RAG-Chat mit Hybrid-Suche und Konversationsgedächtnis.

Eine Privacy-first Alternative zu allgemeinen KI-Tools für sensible interne Dokumente.

Nexus KI ist ein privater Dokumententresor, der interne Dateien in ein zitierfähiges Wissens-Erlebnis verwandelt. Nutzer laden PDFs und Office-Dokumente hoch und fragen sie in einem Chat ab — Antworten streamen und zeigen explizite Quellen-Badges. Die App kann als öffentliches Demo laufen oder bei aktivierter Auth Sign-in + Nutzer-Isolation erzwingen. Technisch besteht sie aus einer Ingestion-Pipeline (extrahieren → chunken → embedden → Pinecone) plus guarded Retrieval (hybride Vektoren, Keyword-Fallback, optionales Reranking) und Observability (Audit-Logs und Usage Events).

Architektur

Funktionen

- Quellen-First Chat — Streaming-Antworten mit expliziten Badges wie [Source: file.pdf, Page N], UI rendert daraus Source-Chips.

- Guarded Hybrid Retrieval — Dense Vektorsuche (Gemini Embeddings) mit optionalem Sparse-Recall und Keyword-Fallback bei niedriger Konfidenz; optional Cohere Rerank.

- Konversationsgedächtnis — verdichtet die letzten 4 Nachrichten zu einer standalone Query, damit Follow-ups Kontext behalten.

- Ingestion mit Lifecycle — Document: PROCESSING → COMPLETE/FAILED mit chunksCount; unterstützt PDF/TXT/MD/DOCX/XLSX.

- Enterprise Controls — optionale Auth + Multi-Tenancy, RBAC (VIEWER), Rate Limiting, Audit-Logs, Usage Events und Public API Keys.

Enterprise-Anforderungen (Checkliste)

- Datenschutz: Dokumente werden nicht zum Training öffentlicher Modelle genutzt; Daten bleiben getrennt.

- Quellenangaben: Jede Antwort nennt das Ursprungsdokument (und Seite, wenn verfügbar).

- Auth + Zugriff: optionales Sign-in, Rollenrechte (Admin/Editor/Viewer).

- Nachvollziehbarkeit: Audit-Logs (wer fragte was wann) und Usage Events für Kostenmonitoring.

- Integration: API Keys für programmatic Query/Ingest über Public Endpoints.

Security & Betrieb

- Multi-Tenancy: Pinecone Namespaces und DB-Scoping verhindern Cross-Tenant Retrieval.

- Guardrails: Rate Limiting gegen Abuse/Spend; Keyword-Fallback für exakte Begriffe/IDs.

- Deployment-ready: Vercel-friendly Setup plus Docker + CI Checks für Self-Hosted Workflows.

- Observability: strukturierte Logs, Tracing Hooks und persistierte Usage Events für Tuning & Budgets.

Tech-Stack

- Next.js (App Router), TypeScript, Tailwind, Vercel KI SDK — UI + Streaming-Chat

- Gemini (gemini-2.5-flash + Vision), text-embedding-004 (768d) — Chat, Condense, Embeddings

- Pinecone — Vector Store (dense + optional sparse); optional Cohere Rerank

- Prisma + PostgreSQL — Users, Documents, Chat-History, Audit-Logs, Usage Events

Dokumenten-Erfassungspipeline

- Document-Row anlegen (PROCESSING), Ingest von File-URL; COMPLETE (chunksCount) oder FAILED setzen.

- Extraktion nach Typ: PDF (pdf-parse + optional Vision-Zusammenfassung für kleinere PDFs), DOCX (Mammoth), XLSX (Sheet → CSV-Text), TXT/MD (UTF-8).

- Chunking: fixed (1000 Zeichen / 200 Overlap) oder semantisch (satzbasiert) via RAG_CHUNKING=semantic.

- Embeddings mit Gemini text-embedding-004 (768 dims) und Upsert nach Pinecone mit Metadaten (fileName, documentId, optional userId, Snippet).